Ein Feature von Apple iOS, das viele Benutzer nicht kennen, ist die Möglichkeit Fotos zu durchsuchen. Fotos durchsuchen? Wie soll das denn bitte funktionieren?

Sofern bei Fotos Geo-Punkte gesetzt werden, kann man bekanntlich die Fotos zu bestimmten Orten sortieren und auf der Karte anzeigen lassen. iOS erstellt auch Rückblicke, z.B. von Reisen oder Urlaub, wenn an einem Ort bzw. in einem Umfeld mehrere Fotos erstellt werden.

Das erlaubt es schonmal recht gut, dass man Fotos zu bestimmten Orten oder Ereignissen zuordnen kann und haut aber nun wahrlich nicht mehr jeden vom Hocker.

Spannender ist es da schon, wenn man mal schaut, wie sehr Apple in iOS heute schon künstliche Intelligenz einsetzt und sich diese Funktion zu nutzen macht.

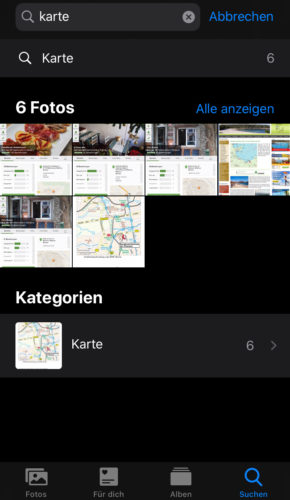

Startet man die Foto App auf dem iPhone, hat man unter iOS 13 die Möglichkeit in der unteren Menüleiste zwischen „Fotos“, „Für Dich“, „Alben“ und „Suchen“ auszuwählen.

Der Titel dieses Posts lässt es schon vermuten: Die Funktion, die wir uns einmal genauer anschauen wollen ist „Suchen“.

„Suchen“ erlaubt es innerhalb der Fotos, die auf dem iPhone abgespeichert sind nach Bildattributen zu suchen, die man selbst niemals mit den Bildern angelegt hat.

Sucht man hier zum Beispiel nach Begriffen wie „Hund“ oder „Katze“, zeigt die Fotos-App einem alle Bilder an, auf denen Hunde oder Katzen zu sehen sind. Das Gleiche funktioniert mit „Haus“, „Kirche“, „Wasser“, „Strand“ oder „Schnee“.

Auch Orte lassen sich problemlos eingeben und mit den Begriffen kombinieren.

Hat man einmal ein paar Personen in Bildern mit Namen identifiziert, wendet Apple die in der Photos App eingebaute Gesichtserkennung auf alle anderen Fotos und zukünftigen Fotos an und die Suche funktioniert fortan auch mit Namen.

Was noch nicht klappt ist Text in Fotos automatisch zu erkennen. Da muss Apple dann wohl nochmal nachlegen…